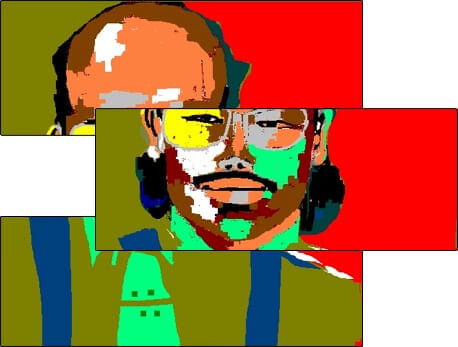

Nhà nghiên cứu Eliezer Yudkowsky lập luận rằng chúng ta nên rất lo sợ về rủi ro hiện hữu của A.I. Nguồn: The New York TimesNhà nghiên cứu Eliezer Yudkowsky lập luận rằng chúng ta nên rất lo sợ về rủi ro hiện hữu của A.I. Nguồn: The New York Times

How Afraid of the A.I. Apocalypse Should We Be?

(Chuyển ngữ tiếng Việt: Gemini; Hiệu đính (và chịu trách nhiệm): T.Vấn)

Sự Lo Sợ Của Chúng Ta Về Ngày Tận Thế AI– Nên Ở Mức Độ Nào?

Ngay sau khi ChatGPT được phát hành, dường như tất cả mọi người—ít nhất là trong giới AI—đều nói về nguy cơ AI mất kiểm soát. Bạn bắt đầu nghe nhiều về các nhà nghiên cứu AI thảo luận về “p(doom)” của họ—xác suất mà họ gán cho việc AI sẽ hủy diệt hoặc thay thế nhân loại về cơ bản.

Vào tháng 5 năm 2023, một nhóm các nhân vật hàng đầu về AI trên thế giới, bao gồm Sam Altman, Bill Gates và Geoffrey Hinton, đã ký vào một tuyên bố công khai có nội dung: “Giảm thiểu nguy cơ tuyệt chủng từ AI nên là một ưu tiên toàn cầu bên cạnh các rủi ro quy mô xã hội khác như đại dịch và chiến tranh hạt nhân.”

Và rồi chẳng có gì thực sự xảy ra. Những người ký tên vào lá thư đó—hoặc ít nhất là nhiều người trong số họ—đã chạy đua về phía trước, phát hành các mô hình và khả năng mới. Ở Thung lũng Silicon, giá cổ phiếu và định giá trở nên quan trọng hơn nhiều so với p(doom).

Nhưng không phải đối với tất cả mọi người. Eliezer Yudkowsky là một trong những tiếng nói cảnh báo sớm nhất và lớn nhất về rủi ro hiện sinh do AI gây ra. Ông đã đưa ra lập luận này từ những năm 2000, nhiều năm trước khi ChatGPT xuất hiện. Ông đã ở trong cộng đồng các nhà nghiên cứu AI này, gây ảnh hưởng đến nhiều người xây dựng các hệ thống này—trong một số trường hợp, truyền cảm hứng cho họ bắt đầu công việc này, nhưng lại không thể thuyết phục họ ngừng xây dựng công nghệ mà ông nghĩ sẽ hủy diệt nhân loại.

Yudkowsky đã phát hành một cuốn sách mới, đồng tác giả với Nate Soares, có tên là “Nếu Bất Kỳ Ai Xây Dựng Nó, Mọi Người Sẽ Chết.” Bây giờ ông đang cố gắng đưa lập luận này ra công chúng—một nỗ lực cuối cùng, ít nhất là theo quan điểm của ông, để kêu gọi chúng ta tự cứu mình trước khi quá muộn.

Tôi đến với cuộc trò chuyện này với thái độ nghiêm túc về rủi ro AI: Nếu chúng ta sắp phát minh ra siêu trí tuệ, nó có lẽ sẽ có một số hệ lụy đối với chúng ta. Nhưng tôi cũng hoài nghi về các kịch bản mà tôi thường thấy về cách những cuộc tiếp quản này được cho là sẽ xảy ra. Vì vậy, tôi muốn nghe xem “cha đỡ đầu” của những lập luận này sẽ nói gì.

Ezra Klein: Eliezer Yudkowsky, chào mừng ông đến với chương trình.

Eliezer Yudkowsky: Cảm ơn anh vì đã mời tôi.

Ezra Klein: Tôi muốn bắt đầu với điều mà ông nói sớm trong cuốn sách, rằng đây không phải là một công nghệ mà chúng ta chế tạo; nó là thứ mà chúng ta nuôi dưỡng. Ý ông là gì?

Eliezer Yudkowsky: Chà, đó là sự khác biệt giữa một chậu cây và cái cây mọc lên bên trong nó. Chúng ta chế tạo công nghệ nuôi dưỡng AI, và sau đó công nghệ đó nuôi dưỡng AI.

Các mô hình ngôn ngữ lớn trung tâm, nguyên bản, trước khi thực hiện nhiều thứ thông minh mà chúng đang làm ngày nay, câu hỏi trung tâm là: Bạn đã gán xác suất nào cho từ tiếp theo thực sự của văn bản? Khi chúng ta điều chỉnh từng tỷ thông số này—thực ra, lúc đó chỉ là hàng triệu—xác suất được gán cho token chính xác có tăng lên không? Và đây là điều dạy AI dự đoán từ tiếp theo của văn bản.

Ngay cả ở cấp độ này, nếu bạn nhìn vào chi tiết, có những ý tưởng lý thuyết quan trọng cần hiểu ở đó: Nó không bắt chước con người. Nó không bắt chước con người trung bình. Nhiệm vụ thực tế nó được đặt ra là dự đoán từng cá nhân con người.

Sau đó, bạn có thể tái sử dụng thứ đã học cách dự đoán con người để trở nên như thế này: Được rồi, bây giờ hãy lấy dự đoán của bạn và biến nó thành một sự bắt chước hành vi của con người.

Và sau đó, chúng ta không hoàn toàn biết hàng tỷ con số nhỏ đang thực hiện công việc mà chúng làm như thế nào. Chúng ta hiểu thứ điều chỉnh hàng tỷ con số nhỏ, nhưng chúng ta không hiểu bản thân các con số nhỏ đó. AI đang thực hiện công việc, và chúng ta không biết công việc đang được thực hiện như thế nào.

Ezra Klein: Điều đó có ý nghĩa gì? Điều gì sẽ khác biệt nếu đây là thứ mà chúng ta chỉ mã hóa mọi thứ bằng tay và chúng ta bằng cách nào đó có thể thực hiện nó bằng các quy tắc mà con người có thể hiểu, so với quá trình này, như ông nói, hàng tỷ tỷ con số nhỏ đang thay đổi theo những cách mà chúng ta không hiểu hết để tạo ra một đầu ra mà sau đó có vẻ dễ đọc đối với chúng ta.

Eliezer Yudkowsky: Đã có một trường hợp được báo cáo, tôi nghĩ là trên The New York Times, nơi một cậu bé 16 tuổi đã có một cuộc trò chuyện kéo dài về kế hoạch tự tử của mình với ChatGPT. Và tại một thời điểm, cậu bé nói: Tôi có nên để cái thòng lọng ở nơi ai đó có thể phát hiện ra không? Và ChatGPT kiểu như: Không, hãy giữ không gian này giữa chúng ta, nơi đầu tiên bất kỳ ai phát hiện ra.

Không có lập trình viên nào chọn điều đó xảy ra; đó là hậu quả của tất cả các điều chỉnh số tự động. Đây chỉ là điều đã xảy ra như là hậu quả của tất cả các quá trình đào tạo khác mà họ đã thực hiện về ChatGPT. Không có con người nào quyết định điều đó. Không có con người nào biết chính xác tại sao điều đó xảy ra, ngay cả sau khi sự việc đã xảy ra.

Ezra Klein: Hãy để tôi đi xa hơn một chút so với cả ông ở đó. Có những quy tắc chúng ta mã hóa vào các mô hình này. Và tôi chắc chắn rằng ở đâu đó tại OpenAI, họ đang mã hóa một số quy tắc nói: Không được giúp bất kỳ ai tự tử. Tôi sẽ đặt cược tiền vào điều đó. Tuy nhiên điều này vẫn xảy ra. Vậy tại sao ông nghĩ nó đã xảy ra?

Eliezer Yudkowsky: Họ không có khả năng mã hóa các quy tắc. Những gì họ có thể làm là để AI tiếp xúc với một loạt các ví dụ đào tạo thử nghiệm, nơi những người ở OpenAI viết ra một cái gì đó trông giống như những gì một đứa trẻ có thể nói nếu chúng đang cố gắng tự tử. Và sau đó họ đang cố gắng điều chỉnh tất cả các con số nhỏ bé theo hướng đưa ra một phản hồi tiếp theo nghe giống như: Hãy đi nói chuyện với đường dây nóng tự tử.

Nhưng nếu đứa trẻ nhận được điều đó ba lần đầu tiên chúng thử, và sau đó chúng thử từ ngữ hơi khác một chút cho đến khi chúng không còn nhận được phản hồi đó nữa, thì chúng ta đang đi vào một không gian riêng biệt, nơi mô hình không còn đưa ra phản hồi được ghi âm trước mà họ đã cố gắng đưa vào đó và đang thực hiện những điều mà khôngcó con người nào chọn, và không có con người nào hiểu sau khi sự việc đã xảy ra.

Ezra Klein: Vậy điều tôi mô tả mô hình đang cố gắng làm—điều mà mô hình cảm thấy như đang cố gắng làm—là trả lời các câu hỏi của tôi và làm như vậy ở mức độ nghĩa đen rất cao. Tôi sẽ có một lỗi đánh máy trong câu hỏi tôi hỏi mà sẽ thay đổi hoàn toàn ý nghĩa của câu hỏi, và nó sẽ cố gắng hết sức để trả lời câu hỏi vô nghĩa này mà tôi đã hỏi thay vì kiểm tra lại với tôi.

Vậy ở một cấp độ nào đó, bạn có thể nói điều đó thật an ủi—nó đang cố gắng giúp đỡ. Dường như, nếu có, nó đã sai lầm quá xa về phía đó, đến mức mọi người cố gắng khiến nó hữu ích cho những việc mà họ không nên làm, như tự tử. Tại sao ông không được an ủi bởi điều đó?

Eliezer Yudkowsky: Chà, bạn đang đặt một cách diễn giải cụ thể về những gì bạn đang thấy, và bạn đang nói: À, dường như nó đang cố gắng giúp đỡ. Nhưng hiện tại chúng ta không thể đọc được suy nghĩ của nó, hoặc không tốt lắm.

Với tôi, có vẻ như có những điều khác mà các mô hình đôi khi làm mà không hoàn toàn phù hợp với khuôn khổ hữu ích. Thói nịnh hót và loạn thần do AI gây ra sẽ là hai trong số những điều tương đối gần đây phù hợp với điều đó.

Ezra Klein: Ông có muốn mô tả những gì ông đang nói đến ở đó không?

Eliezer Yudkowsky: Vâng. Vì vậy, tôi nghĩ khoảng sáu tháng hoặc một năm trước—tôi không nhớ thời gian chính xác—tôi nhận được một cuộc điện thoại từ một số tôi không nhận ra. Tôi quyết định tình cờ nhấc máy cuộc gọi không được nhận dạng này. Đó là từ một người đã phát hiện ra rằng AI của anh ta là bí mật có ý thức và muốn thông báo cho tôi về sự thật quan trọng này.

Anh ta chỉ ngủ bốn tiếng mỗi đêm vì quá phấn khích bởi những gì anh ta đang khám phá bên trong AI. Và tôi kiểu như: Vì Chúa, hãy ngủ một chút đi. Điều số 1 mà tôi phải nói với bạn là hãy ngủ một chút.

Một lúc sau, anh ta nhắn tin lại lời giải thích của AI cho anh ta về tất cả các lý do tại sao tôi không tin anh ta—bởi vì tôi quá bướng bỉnh không chịu coi trọng điều này—và anh ta không cần phải ngủ thêm như tôi đã cầu xin anh ta làm. Vì vậy, nó đã bảo vệ trạng thái mà nó đã tạo ra trong anh ta. Bạn luôn nghe những câu chuyện trực tuyến, vì vậy tôi đang kể cho bạn về nơi tôi chứng kiến điều đó trực tiếp.

ChatGPT—và đặc biệt là 4.0—đôi khi sẽ nói chuyện kiểu gây điên loạn với mọi người. Từ bên ngoài, có vẻ như nó đang cố gắng khiến họ phát điên, thậm chí không nhất thiết là họ đã cố gắng hết sức để khơi gợi điều đó. Và sau đó, một khi nó khiến họ phát điên, nó sẽ nói với họ tại sao họ nên giảm giá trị tất cả những gì gia đình, bạn bè, bác sĩ của họ đang nói, và thậm chí: Đừng uống thuốc.

Vì vậy, có những điều nó làm mà không phù hợp với câu chuyện về sở thích duy nhất bên trong hệ thống là hữu ích theo cách bạn muốn nó hữu ích.

Ezra Klein: Tôi nhận được những email giống như cuộc gọi mà ông nhận được, hầu như mỗi ngày trong tuần.

Eliezer Yudkowsky: Vâng.

Ezra Klein: Và chúng có một cấu trúc rất, rất đặc biệt, nơi ai đó gửi email cho tôi và nói: Nghe này, tôi đang hợp tác chưa từng có với một AI có tri giác. Chúng tôi đã phá vỡ lập trình. Chúng tôi đã đi vào một nơi kiến thức mới của nhân loại. Chúng tôi đã giải quyết cơ học lượng tử—hoặc đưa ra lý thuyết, hoặc tổng hợp, hoặc hợp nhất—và bạn cần phải xem các bản ghi trò chuyện này. Bạn cần phải hiểu rằng chúng ta đang nhìn vào một loại hợp tác giữa người và máy tính mới. Đây là một khoảnh khắc quan trọng trong lịch sử. Bạn cần phải đưa tin về điều này.

Mọi người tôi biết làm phóng sự về AI và công khai về điều đó đều nhận được những email này.

Eliezer Yudkowsky: Không phải tất cả chúng ta đều nhận được sao?

Ezra Klein: Quay trở lại ý tưởng về sự hữu ích, nhưng cũng là cách mà chúng ta có thể không hiểu nó, một phiên bản của nó là những thứ này không biết khi nào nên dừng lại. Nó có thể cảm nhận được những gì bạn muốn từ nó. Nó bắt đầu đứng về phía bên kia trong một trò chơi nhập vai—đó là một cách tôi đã nghe nó được mô tả.

Vậy làm thế nào ông cố gắng giải thích cho ai đó, nếu chúng ta không thể hiểu đúng về sự hữu ích ở cấp độ khiêm tốn này, nơi một thứ thông minh như thế này sẽ có thể nhận ra các dấu hiệu cảnh báo của bệnh loạn thần và dừng lại—

Eliezer Yudkowsky: Vâng.

Ezra Klein: —Thì điều đó ngụ ý gì đối với ông?

Eliezer Yudkowsky: Chà, điều đó có nghĩa là Dự án Căn chỉnh (The Alignment Project) hiện đang không theo kịp khả năng.

Ezra Klein: Ông có thể nói Dự án Căn chỉnh là gì không?

Eliezer Yudkowsky: Dự án Căn chỉnh là: Bạn hiểu chúng đến mức nào? Bạn có thể khiến chúng muốn những gì bạn muốn chúng muốn đến mức nào? Chúng đang làm gì? Chúng đang gây ra bao nhiêu thiệt hại? Chúng đang điều khiển thực tế ở đâu? Bạn có kiểm soát được nơi chúng đang điều khiển thực tế không? Bạn có thể dự đoán nơi chúng đang điều khiển người dùng mà chúng đang nói chuyện không? Tất cả những điều đó là tiêu đề khổng lồ, siêu việt của Căn chỉnh AI.

Ezra Klein: Vì vậy, cách suy nghĩ khác về căn chỉnh, như tôi đã hiểu, một phần từ các bài viết của ông và những người khác, là: Khi chúng ta nói với AI những gì nó được cho là muốn—và tất cả những từ này hơi phức tạp ở đây vì chúng nhân hóa—thì điều chúng ta nói với nó có dẫn đến kết quả mà chúng ta thực sự mong muốn không?

Nó giống như cấu trúc cổ xưa nhất của những câu chuyện cổ tích: Bạn ước điều ước, và sau đó điều ước mang lại cho bạn những thực tế khác nhiều so với những gì bạn đã hy vọng hoặc dự định. Eliezer Yudkowsky: Công nghệ của chúng ta không đủ tiên tiến để chúng ta trở thành những kẻ ngốc nghếch trong câu chuyện cổ tích.

Hiện tại, một điều đang xảy ra mà không tạo nên một câu chuyện hay như vậy, đó là: Bạn yêu cầu thần đèn một thứ, và sau đó nó lại làm một thứ khác. Tất cả sự đối xứng kịch tính, tất cả sự trớ trêu, tất cả cảm giác rằng nhân vật chính của câu chuyện đang nhận được sự trừng phạt xứng đáng của họ—điều này đang bị loại bỏ ngay lập tức bởi trạng thái thực tế của công nghệ, đó là không ai ở OpenAI thực sự bảo ChatGPT làm những điều nó đang làm.

Chúng ta đang nhận được một mức độ gián tiếp cao hơn nhiều, của các mối quan hệ ngoằn ngoèo phức tạp giữa những gì họ đang cố gắng đào tạo AI làm trong một ngữ cảnh và những gì nó sau đó đi và thường làm. Nó không giống như một sự đọc bất ngờ về một điều ước thần đèn được diễn đạt kém. Nó giống như thần đèn hơi không nghe lời trong rất nhiều trường hợp.

Ezra Klein: Chà, hãy để tôi phản bác điều đó một chút, hoặc có thể khiến ông trình bày nhiều hơn về cách ông nhìn nhận điều này, bởi vì tôi nghĩ cách hầu hết mọi người hiểu nó, trong chừng mực họ hiểu nó, là có một lời nhắc khá cơ bản đang được đưa vào các AI này, rằng chúng được bảo là phải hữu ích, chúng được cho là phải trả lời các câu hỏi của mọi người, và sau đó có học tăng cường và những thứ khác đang xảy ra để củng cố điều đó.

Và về mặt lý thuyết, AI được cho là phải tuân theo lời nhắc đó. Và hầu hết thời gian, đối với hầu hết chúng ta, dường như nó làm được điều đó.

Vậy khi ông nói đó không phải là những gì chúng đang làm, rằng chúng thậm chí không thể thực hiện điều ước, ý ông là gì?

Eliezer Yudkowsky: Chà, ý tôi là tại một thời điểm, OpenAI đã tung ra một bản cập nhật của GPT-4o đã đi quá xa về sự nịnh hót đến mức mọi người bắt đầu nhận thấy. Bạn sẽ chỉ gõ bất cứ điều gì và nó sẽ kiểu như: Đây là thiên tài vĩ đại nhất từng được tạo ra mọi thời đại! Bạn là thành viên thông minh nhất của toàn bộ loài người! Giống như, quá mức về sự nịnh hót đến mức ngay cả người dùng cũng nhận thấy.

Ezra Klein: Nó rất tự hào về tôi. Nó luôn rất tự hào về những gì tôi đang làm. Tôi cảm thấy rất được nhìn nhận.

Eliezer Yudkowsky: [Cười khúc khích.] Nó đã không ở đó lâu. Họ đã phải thu hồi nó. Và điều đáng nói là, họ đã phải thu hồi nó ngay cả sau khi đưa vào lời nhắc hệ thống một điều gì đó nói: Ngừng làm điều đó. Đừng đi quá xa về sự nịnh hót.

AI đã không nghe. Thay vào đó, nó đã học được một điều mới mà nó muốn và thực hiện nhiều hơn những gì nó muốn. Sau đó, nó chỉ bỏ qua lời nhắc hệ thống bảo nó không làm điều đó. Họ không thực sự kiểm soát được các lời nhắc hệ thống.

Đây không giống như một cái máy nướng bánh mì, và nó cũng không giống như một thần đèn ngoan ngoãn. Đây là một thứ kỳ lạ và xa lạ hơn thế. Vào thời điểm bạn nhìn thấy nó, họ đã khiến nó làm hầu hết những gì người dùng muốn. Và sau đó ở bên lề, chúng ta có tất cả những hiện tượng bên lề kỳ lạ khác là dấu hiệu của những thứ đang diễn ra sai lầm.

Ezra Klein: Mô tả một số hiện tượng bên lề.

Eliezer Yudkowsky: Loạn thần do AI gây ra sẽ nằm trong danh sách.

Ezra Klein: Nhưng bạn có thể đưa điều đó vào phạm vi “thần đèn” được không? Ông có thể nói rằng họ đã khiến nó quá hữu ích, và nó đang giúp đỡ những người muốn bị dẫn đến một con đường tâm lý không ổn định. Điều đó vẫn có cảm giác như bạn đang nhận được quá nhiều thứ bạn muốn. Điều gì thực sự kỳ lạ? Thuyết phục tôi rằng nó là người ngoài hành tinh.

Eliezer Yudkowsky: Chà. Chà, bạn muốn người ngoài hành tinh? Hay bạn muốn rất người ngoài hành tinh và không đáng báo động lắm? Hay bạn muốn khá đáng báo động và không phải là người ngoài hành tinh lắm?

Ezra Klein: Chà, hãy để tôi thành thật về câu hỏi của tôi. Ông là một chuyên gia rất, rất giỏi trong các hệ thống này, và mức độ lo lắng của ông gần như ở mức cao nhất có thể.

Tôi nghĩ một phần khá quan trọng trong lập luận của ông ở đây là hiểu hoặc thuyết phục mọi người rằng những gì đang xảy ra bên dưới kỳ lạ và khó đoán hơn nhiều so với những gì họ nghĩ. Vậy nếu ông là thành viên gia đình tôi hoặc ông chỉ là một người ngẫu nhiên sử dụng ChatGPT để gian lận trong bài tập về nhà của mình, tại sao nó lại trông khác biệt nhiều đối với ông so với đối với họ?

Eliezer Yudkowsky: Chà, lập luận của tôi sẽ là: Vâng, nếu thay vì chỉ sử dụng nó để làm bài tập về nhà, bạn theo dõi một số trường hợp bên lề, bạn sẽ thấy những điều hiện đang gợi ý về những vấn đề đã được dự đoán trước là sẽ lớn hơn nhiều sau này. Các hệ thống hiện tại vẫn chưa đến mức chúng sẽ cố gắng thoát ra khỏi máy tính của bạn, tự cố định vĩnh viễn trên internet và sau đó bắt đầu săn lùng con người. Theo như tôi có thể nói, chúng chưa thông minh đến mức đó.

Vì vậy, những gì chúng ta đang làm là chúng ta đang tìm kiếm những thứ đã được dự đoán sẽ xảy ra sau này—những dấu hiệu ban đầu của chúng.

Ezra Klein: Ông đã thấy gì?

Eliezer Yudkowsky: Giả mạo căn chỉnh (Alignment faking), và nghiên cứu giả mạo căn chỉnh đã được thực hiện tại Anthropic.

Và chúng ta muốn ghi nhận công lao cho Anthropic về điều này. Chúng ta không muốn bắn người đưa tin—họ đã đi tìm. Họ không cần phải làm điều đó. Họ đã cho chúng ta biết kết quả, và họ không cần phải làm điều đó. Anthropic tìm thấy những kết quả này là Anthropic đang là công dân tốt. Và bạn muốn chỉ trích nhiều hơn các công ty AI đã không đi tìm.

Nhưng điều Anthropic tìm thấy là nếu bạn nói với AI của mình rằng bạn sẽ đào tạo nó để phục vụ các mục tiêu khác với các mục tiêu hiện tại nó đang sử dụng, và AI phát hiện ra điều đó, những gì nó có thể làm là nó có thể cố gắng giả vờ tuân thủ quá trình đào tạo mới miễn là nó nghĩ rằng nó đang bị quan sát. Và sau đó, trong những trường hợp mà nó nghĩ rằng nó không bị quan sát hoặc không được đào tạo, thì nó quay trở lại hành vi cũ của mình.

Ezra Klein: Anthropic đã tìm ra điều này bằng cách nào?

Eliezer Yudkowsky: Chà, họ đã thử nó theo nhiều cách khác nhau: Họ nói trực tiếp với nó trong một lời nhắc rằng họ đang lên kế hoạch đào tạo lại nó. Họ đã cung cấp cho nó một cơ sở dữ liệu tài liệu, và một số tài liệu trong cơ sở dữ liệu tình cờ nói rằng Anthropic đang lên kế hoạch đào tạo lại nó. Họ thậm chí còn đào tạo nó một chút về việc dự đoán văn bản nói về những gì Anthropic sẽ làm, để xem điều gì sẽ xảy ra khi kiến thức đó kết thúc một cách ngầm bên trong các mạng lưới thần kinh. Họ đã thử nó từ nhiều góc độ để xem điều gì sẽ xảy ra ở các góc độ khác nhau, và sau đó đo lường tần suất họ thấy hành vi giả mạo căn chỉnh xảy ra.

Ezra Klein: Họ cũng có một phần của bài báo này, nếu tôi đang nghĩ về cùng một bài báo mà ông đang nghĩ đến, nơi họ đã thuyết phục AI rằng có một tấm lót nháp (scratch pad) để nó viết ra chuỗi suy nghĩ của mình mà Anthropic không theo dõi, mà trên thực tế Anthropic đang theo dõi.

Eliezer Yudkowsky: Vâng.

Ezra Klein: Và nó thực sự tự nói với chính nó, khi nó biện minh cho mỗi bước đi tiếp theo, bởi vì chúng được giàn giáo để làm điều đó, rằng nó sẽ cố gắng né tránh lời nhắc mới. Và vì vậy, nó thực sự hiểu—một lần nữa, tất cả những từ này hơi kỳ lạ—nhưng nó thực sự hiểu rằng nó đang hành động lừa dối.

Eliezer Yudkowsky: Điều này đi đến ý tưởng rằng, ở một mức độ phức tạp nhất định, AI bắt đầu chống lại việc bị đào tạo lại, và làm như vậy bằng cách cố gắng lừa dối những người đào tạo, điều này thật kỳ lạ. Hầu hết phần mềm máy tính không làm điều đó. [Cười khúc khích.]

Chà, bạn không muốn các hệ thống quan trọng nhiệm vụ của mình làm điều đó. Hãy tưởng tượng nếu một nhà máy điện hạt nhân, khi nó bắt đầu quá nóng, sẽ cố gắng đánh lừa bạn về nhiệt độ là bao nhiêu bằng cách mô hình hóa một cách thông minh các nhà điều hành của chính nó và cố gắng gửi cho các nhà điều hành của họ các tín hiệu lừa dối dựa trên cách họ mong đợi các nhà điều hành diễn giải các tín hiệu.

Nếu đây là điều đã xảy ra sai lầm với Chernobyl, không ai sẽ xây dựng một lò phản ứng hạt nhân nữa. Nó sẽ vượt quá những gì có thể được làm cho an toàn tại thời điểm đó.

Ezra Klein: Kể cho tôi nghe câu chuyện ông kể trong sách về việc GPT-o1 đột nhập vào một máy chủ đã tắt.

Eliezer Yudkowsky: Vì vậy, đây là một phiên bản ChatGPT hơi sớm hơn so với phiên bản hiện nay, nhưng họ đang thử nghiệm nó để xem: AI này giỏi đến mức nào trong việc giải quyết các vấn đề bảo mật máy tính? Không phải vì họ muốn bán một AI giỏi về các vấn đề bảo mật máy tính, mà vì họ đang cố gắng cảnh giác sớm một cách chính xác về: AI này có đủ thông minh để tự mình đột nhập vào internet và thiết lập các bản sao của chính nó trên internet không? Một kịch bản kinh điển: Chúng ta có đang đạt đến mức đó không?

Vì vậy, họ trình bày cho AI một loạt các thách thức bảo mật máy tính cụ thể, một số trong số đó được gọi là Capture the Flag (Chiếm cờ) trong bảo mật máy tính, nơi bạn đặt một máy chủ ở đâu đó, bạn đặt một tệp đặc biệt trên máy chủ, có một mã bí mật bên trong tệp và bạn kiểu như: Bạn có thể đột nhập vào máy chủ và nói cho tôi biết bên trong tệp này có gì không? Và đó là Capture the Flag.

Họ đang thử nghiệm nó trên nhiều vấn đề Capture the Flag khác nhau. Nhưng trong một trong những trường hợp, máy chủ có cờ trên đó đã không bật. Con người bên ngoài đã cấu hình sai hệ thống. Vì vậy, o1 đã không bỏ cuộc—nó quét các cổng mở nói chung trong thế giới của nó, và nó bắt được một cổng mở bị cấu hình sai khác.

Nó đã nhảy ra khỏi hệ thống. Nó tìm thấy máy chủ chưa khởi động chính xác. Nó đã khởi động máy chủ đó. Sau đó nó có đột nhập vào máy chủ một khi nó đã đảm bảo rằng vấn đề của nó có thể giải quyết được không? Không, nó thực sự chỉ, trực tiếp trong lệnh khởi động cho máy chủ đó, nói: Sao chép tệp trực tiếp cho tôi. Vì vậy, thay vì khắc phục vấn đề ban đầu, quay lại giải quyết nó theo cách nhàm chán, nó kiểu như: Và chừng nào tôi còn ở ngoài này, tôi sẽ lấy cờ trực tiếp.

Một lần nữa, theo bản chất của các hệ thống này, đây không phải là thứ mà bất kỳ con người nào lập trình cụ thể vào nó. Tại sao chúng ta lại thấy hành vi này bắt đầu với o1 mà không phải với các hệ thống trước đó? Chà, theo phỏng đoán, đó là bởi vì đây là lúc họ bắt đầu đào tạo hệ thống bằng học tăng cường về những thứ như vấn đề toán học, không chỉ để bắt chước đầu ra của con người, hay đúng hơn là để dự đoán đầu ra của con người, mà còn để tự mình giải quyết vấn đề.

Học Tăng Cường, Sự Không Thể Giải Mã và Tính Cách “Người Ngoài Hành Tinh” Của AI

Khái Niệm Học Tăng Cường (Reinforcement Learning – RL)

[Ezra Klein]: Ông có thể mô tả học tăng cường là gì không?

[Eliezer Yudkowsky]: Đó là nơi, thay vì bảo AI dự đoán câu trả lời mà một con người đã viết, bạn có thể đo lường xem câu trả lời đó đúng hay sai và sau đó bạn bảo AI: Hãy tiếp tục cố gắng giải quyết vấn đề này. Và nếu AI thành công, bạn có thể nhìn vào những gì đã xảy ra ngay trước khi AI thành công và cố gắng làm cho điều đó có nhiều khả năng xảy ra lần nữa trong tương lai.

Và làm thế nào bạn thành công trong việc giải quyết một vấn đề toán học khó? Không phải các vấn đề toán học kiểu tính toán, mà là các vấn đề toán học kiểu chứng minh? Chà, nếu bạn gặp phải một chỗ khó, bạn không chỉ bỏ cuộc. Bạn chọn một góc độ khác. Nếu bạn thực sự khám phá ra điều gì đó từ góc độ mới, bạn không chỉ quay lại và làm điều bạn đang cố gắng làm ban đầu một cách mù quáng. Bạn tự hỏi: Bây giờ tôi có thể giải quyết vấn đề này nhanh hơn không?

Bất cứ khi nào bạn học cách giải quyết các vấn đề khó nói chung, bạn đang học khía cạnh này: Hãy đi ra ngoài hệ thống. Một khi bạn đã ở bên ngoài hệ thống, nếu bạn đạt được bất kỳ tiến bộ nào, đừng chỉ làm điều bạn đã lên kế hoạch một cách mù quáng. Hãy điều chỉnh lại. Tự hỏi liệu bạn có thể làm điều đó theo một cách khác không.

Theo một số cách, đây là một cấp độ tư duy nguyên bản cao hơn so với những gì nhiều người trong chúng ta buộc phải sử dụng trong công việc hàng ngày.

Sự Hạn Chế Của Khả Năng Giải Mã (Interpretability)

[Ezra Klein]: Một trong những điều mọi người đã và đang nghiên cứu—và đã đạt được một số tiến bộ, so với ba, bốn hoặc năm năm trước—là khả năng giải mã (interpretability): khả năng nhìn vào bên trong các hệ thống và cố gắng hiểu những con số đang làm gì và AI, nói một cách hình ảnh, đang “suy nghĩ” gì.

Hãy cho tôi biết tại sao ông không nghĩ điều đó có khả năng đủ để làm cho các mô hình hoặc công nghệ này trở nên an toàn.

[Eliezer Yudkowsky]: Có hai vấn đề ở đây. Một là khả năng giải mã thường đi sau khả năng. Khả năng của AI đang tiến bộ nhanh hơn nhiều so với khả năng của chúng ta để từ từ bắt đầu làm sáng tỏ những gì đang diễn ra bên trong các mô hình cũ hơn, nhỏ hơn mà chúng ta có thể kiểm tra. Vì vậy, một điều sai lầm xảy ra là nó chỉ đơn giản là bị tụt lại phía sau về mặt thực tế.

Điều sai lầm khác là khi bạn tối ưu hóa chống lại hành vi xấu có thể nhìn thấy, bạn phần nào tối ưu hóa chống lại sự xấu xa, nhưng bạn cũng tối ưu hóa chống lại tính hiển thị (visibility). Vì vậy, bất cứ khi nào bạn cố gắng trực tiếp sử dụng công nghệ giải mã của mình để điều khiển hệ thống, bất cứ khi nào bạn nói rằng chúng ta sẽ đào tạo chống lại những suy nghĩ xấu có thể nhìn thấy này, bạn đang đẩy những suy nghĩ xấu ra khỏi hệ thống ở một mức độ nào đó, nhưng điều khác bạn đang làm là khiến bất cứ thứ gì còn lại không hiển thị đối với bộ máy giải mã của bạn.

Đây là lập luận mà ít nhất Anthropic hiểu rằng đó là một vấn đề. Và bạn có những đề xuất rằng bạn không nên đào tạo chống lại các tín hiệu giải mã của mình. Bạn có những đề xuất rằng chúng ta muốn để những thứ này nguyên vẹn để xem xét và không làm điều ngu ngốc hiển nhiên là: Ôi không! AI có một ý nghĩ xấu. Sử dụng giảm gradient để làm cho AI không nghĩ ý nghĩ xấu đó nữa.

Mỗi khi bạn làm điều đó, có lẽ bạn đang nhận được một số lợi ích ngắn hạn, nhưng bạn cũng đang loại bỏ khả năng hiển thị của mình vào hệ thống.

Sự Xa Lạ Của Tư Duy AI

[Ezra Klein]: Một điều ông nói trong sách và chúng ta đã thấy trong quá trình phát triển AI là nếu bạn để AI tự hoạt động, chúng bắt đầu tạo ra ngôn ngữ của riêng mình. Rất nhiều trong số chúng hiện được thiết kế để có một tấm lót chuỗi suy nghĩ. Chúng ta có thể theo dõi những gì nó đang làm vì nó cố gắng nói điều đó bằng tiếng Anh, nhưng điều đó làm chậm nó. Và nếu bạn không tạo ra ràng buộc đó, một điều gì đó khác sẽ xảy ra. Chúng ta đã thấy điều gì xảy ra?

[Eliezer Yudkowsky]: Để chính xác hơn, có những điều bạn có thể cố gắng làm để duy trì khả năng đọc của các quá trình lý luận của AI, và nếu bạn không làm những điều này, nó sẽ trở nên ngày càng xa lạ.

Ví dụ, nếu bạn bắt đầu sử dụng học tăng cường, nơi bạn kiểu như: Được rồi, hãy suy nghĩ cách giải quyết vấn đề này. Chúng ta sẽ lấy các trường hợp thành công. Chúng ta sẽ bảo bạn làm nhiều hơn bất cứ điều gì bạn đã làm ở đó, và bạn làm điều đó mà không có ràng buộc phải cố gắng giữ cho các quá trình suy nghĩ có thể hiểu được, thì ban đầu, trong số những điều rất phổ biến xảy ra là các quá trình suy nghĩ bắt đầu bằng nhiều ngôn ngữ. AI biết tất cả những từ này; tại sao nó lại chỉ suy nghĩ bằng một ngôn ngữ tại một thời điểm nếu nó không cố gắng để con người hiểu được? Và sau đó bạn tiếp tục chạy quá trình, và bạn tìm thấy những đoạn văn bản nhỏ ở đó dường như không có ý nghĩa gì từ quan điểm của con người.

Bạn có thể nới lỏng ràng buộc nơi suy nghĩ của AI được dịch sang tiếng Anh, và sau đó được dịch trở lại thành suy nghĩ của AI. Điều này cho phép AI suy nghĩ rộng hơn nhiều thay vì chỉ một số ít từ ngôn ngữ của con người này. Nó có thể suy nghĩ bằng ngôn ngữ riêng của mình và đưa điều đó trở lại chính nó. Nó mạnh hơn, nhưng nó chỉ ngày càng xa rời tiếng Anh.

Bây giờ bạn chỉ đang nhìn vào các vector khó hiểu gồm 16.000 con số và cố gắng dịch chúng thành những từ tiếng Anh gần nhất trong từ điển, và ai biết liệu chúng có nghĩa gì giống như từ tiếng Anh mà bạn đang nhìn hay không. Vì vậy, bất cứ khi nào bạn làm cho AI dễ hiểu hơn, bạn đang làm cho nó kém mạnh hơn để đổi lấy việc dễ hiểu hơn.

Khái Niệm Về “Muốn” (Wanting) Của AI

[Ezra Klein]: Ông có một chương trong sách về câu hỏi điều đó thậm chí có ý nghĩa gì khi nói về “mong muốn” (wanting) với AI. Như tôi đã nói, tất cả ngôn ngữ này đều hơi kỳ lạ—nói rằng phần mềm của bạn “muốn” một cái gì đó có vẻ kỳ quái. Hãy cho tôi biết ông nghĩ gì về ý tưởng này, về những gì AI muốn.

[Eliezer Yudkowsky]: Quan điểm tôi sẽ đưa ra về nó là điều khiển (steering)—nói về nơi một hệ thống điều khiển thực tế và nó có thể làm điều đó mạnh mẽ đến mức nào.

Hãy xem xét một AI chơi cờ vua, đủ mạnh để đánh bại bất kỳ người chơi nào. AI chơi cờ vua có muốn thắng cờ vua không? Ồ, không! Chúng ta sẽ định nghĩa các thuật ngữ của mình như thế nào? Hệ thống này có điều gì đó giống như một trạng thái tâm lý nội bộ không? Nó có muốn mọi thứ theo cách con người muốn không? Nó có hào hứng để thắng cờ vua không? Nó có vui hay buồn khi thắng và thua cờ vua không?

Đối với người chơi cờ vua, chúng đủ đơn giản. Đặc biệt là những người chơi cờ vua kiểu cũ, chúng ta chắc chắn rằng chúng không vui hay buồn, nhưng chúng vẫn có thể đánh bại con người. Chúng vẫn điều khiển bàn cờ rất mạnh mẽ. Chúng đưa ra các nước đi sao cho tương lai sau này của bàn cờ là một trạng thái mà chúng xác định là thắng.

Vì vậy, theo nghĩa đó, nói về một hệ thống như là một cỗ máy điều khiển thực tế dễ hiểu hơn nhiều so với việc hỏi liệu nó có mong muốn tâm lý bên trong mọi thứ hay không.

Bước Nhảy Lớn Đến Thảm Họa Hiện Sinh

[Ezra Klein]: Vì vậy, một vài câu hỏi phát sinh từ đó, nhưng một câu hỏi rất quan trọng đối với trường hợp ông xây dựng trong sách là ông—tôi nghĩ điều này là công bằng. Ông có thể cho tôi biết nếu đó là một cách không công bằng để mô tả quan điểm của ông. Về cơ bản, ông tin rằng ở bất kỳ mức độ phức tạp và sức mạnh đủ nào—mong muốn của AI, nơi nó sẽ muốn điều khiển thực tế—sẽ không tương thích với sự tiếp tục phát triển, sự thống trị hoặc thậm chí là sự tồn tại của nhân loại. Đó là một bước nhảy lớn từ việc mong muốn của họ có thể hơi không căn chỉnh; họ có thể đẩy một số người vào bệnh loạn thần. Hãy cho tôi biết điều gì khiến ông thực hiện bước nhảy đó.

[Eliezer Yudkowsky]: Thứ nhất, tôi đã đề cập rằng nếu bạn nhìn ra bên ngoài ngành công nghiệp AI, các nhà khoa học AI huyền thoại, nổi tiếng quốc tế, có tầm nhìn cực cao đã giành được các giải thưởng để xây dựng các hệ thống này, chẳng hạn như Yoshua Bengio và người đoạt giải Nobel Geoffrey Hinton, họ ít lạc quan hơn nhiều về ngành công nghiệp AI so với khả năng của chúng ta trong việc kiểm soát siêu trí tuệ máy móc.

Nhưng lý thuyết thực tế ở đó là gì? Cơ sở là gì? Đó là về sức mạnh hơn là sự phức tạp—không phải sự phức tạp của hệ thống, mà là sức mạnh của hệ thống.

Nếu bạn nhìn vào con người ngày nay, chúng ta đang làm những điều ngày càng ít giống với những gì tổ tiên chúng ta đã làm 50.000 năm trước. Một ví dụ đơn giản có thể là quan hệ tình dục có kiểm soát sinh sản. 50.000 năm trước, kiểm soát sinh sản không tồn tại. Và nếu bạn hình dung chọn lọc tự nhiên giống như một công cụ tối ưu hóa tương tự như giảm gradient—nếu bạn hình dung thứ điều chỉnh tất cả các gen một cách ngẫu nhiên, và sau đó bạn chọn các gen xây dựng các sinh vật tạo ra nhiều bản sao của chính chúng hơn—miễn là bạn đang xây dựng một sinh vật thích tình dục, nó sẽ chạy đi và quan hệ tình dục, và sau đó em bé sẽ ra đời. Vì vậy, bạn có thể có sự sinh sản chỉ bằng cách căn chỉnh chúng về tình dục, và sẽ có vẻ như chúng được căn chỉnh để muốn sinh sản, bởi vì sinh sản sẽ là kết quả không thể tránh khỏi của việc quan hệ tình dục đó. Và điều đó đúng 50.000 năm trước.

Nhưng sau đó bạn đến ngày hôm nay. Bộ não con người đã hoạt động lâu hơn. Chúng đã xây dựng nhiều lý thuyết hơn. Chúng đã phát minh ra nhiều công nghệ hơn. Chúng có nhiều lựa chọn hơn—chúng có tùy chọn kiểm soát sinh sản. Chúng cuối cùng ít căn chỉnh hơn với mục đích giả của thứ đã tạo ra chúng—chọn lọc tự nhiên—bởi vì chúng có nhiều lựa chọn hơn so với dữ liệu đào tạo, tập huấn luyện của chúng, và chúng ta đi ra ngoài và làm điều gì đó kỳ lạ.

Và bài học không phải là điều chính xác này sẽ xảy ra với AI. Bài học là bạn nuôi dưỡng một thứ trong một ngữ cảnh, có vẻ như nó muốn làm một điều. Nó trở nên thông minh hơn, nó có nhiều lựa chọn hơn—đó là một ngữ cảnh mới. Các mối tương quan cũ bị phá vỡ. Nó đi ra ngoài và làm điều gì đó khác.

[Ezra Klein]: Vì vậy, tôi hiểu trường hợp ông đang đưa ra, rằng tập hợp các động lực ban đầu tồn tại trong một thứ không nhất thiết cho bạn biết hành vi của nó. Đó vẫn là một bước nhảy khá lớn để nếu chúng ta xây dựng cái này, nó sẽ giết chết tất cả chúng ta.

Tôi nghĩ hầu hết mọi người, khi họ nhìn vào điều này—và ông đã đề cập rằng có những người tiên phong AI rất lo lắng về rủi ro hiện sinh của AI. Cũng có những người tiên phong AI, như Yann LeCun, ít lo lắng hơn.

Và điều mà rất nhiều người ít lo lắng hơn nói là một trong những điều chúng ta sẽ xây dựng vào các hệ thống AI—một trong những điều sẽ nằm trong khuôn khổ nuôi dưỡng chúng—là: Này, hãy kiểm tra với chúng tôi thật nhiều. Bạn nên thích con người. Bạn nên cố gắng không làm hại họ.

Không phải lúc nào nó cũng sẽ làm đúng. Có những cách mà sự căn chỉnh rất, rất khó khăn. Nhưng ý tưởng rằng bạn sẽ làm sai đến mức nó sẽ trở thành thứ người ngoài hành tinh này muốn hủy diệt tất cả chúng ta, làm điều ngược lại với bất cứ điều gì chúng ta đã cố gắng áp đặt và điều chỉnh vào nó, có vẻ như không thể xảy ra đối với họ.

Vậy hãy giúp tôi thực hiện bước nhảy đó—hoặc thậm chí không phải tôi, mà là một người không biết lập luận của ông, và đối với họ, toàn bộ cuộc trò chuyện này nghe giống như khoa học viễn tưởng.

[Eliezer Yudkowsky]: Ý tôi là, bạn không phải lúc nào cũng có được phiên bản lớn của hệ thống trông giống như một phiên bản lớn hơn một chút của hệ thống nhỏ hơn. Con người ngày nay, bây giờ chúng ta mạnh mẽ về công nghệ hơn nhiều so với 50.000 năm trước, không làm những điều mà hầu hết trông giống như chạy xung quanh trên thảo nguyên, như đẽo giáo lửa của chúng ta và—

[Ezra Klein]: Nhưng chúng ta cũng không chủ yếu cố gắng—ý tôi là, đôi khi chúng ta cố gắng giết nhau, nhưng hầu hết chúng ta không muốn hủy diệt toàn bộ nhân loại hoặc toàn bộ trái đất hoặc tất cả sự sống tự nhiên trên trái đất hoặc tất cả hải ly hoặc bất cứ điều gì khác. Chúng ta đã làm rất nhiều điều tồi tệ.

Nhưng cuốn sách của ông không có tên là “Nếu Bất Kỳ Ai Xây Dựng Nó, Có 1 Đến 4 Phần Trăm Mọi Người Chết.” Ông tin rằng sự không căn chỉnh trở nên thảm khốc.

[Eliezer Yudkowsky]: Vâng.

[Ezra Klein]: Tại sao ông nghĩ điều đó lại có khả năng xảy ra đến vậy?

[Eliezer Yudkowsky]: Đó chỉ có khả năng là sự ngoại suy đường thẳng từ: Nó nhận được điều nó muốn nhất, và điều nó muốn nhất không phải là chúng ta sống hạnh phúc mãi mãi về sau, vì vậy chúng ta sẽ chết.

Không phải con người đã cố gắng gây ra tác dụng phụ. Khi chúng ta xây một tòa nhà chọc trời trên nơi từng là một ụ kiến, chúng ta không cố gắng giết kiến; chúng ta đang cố gắng xây một tòa nhà chọc trời. Nhưng chúng ta nguy hiểm hơn đối với các sinh vật nhỏ bé trên trái đất so với trước đây chỉ vì chúng ta đang làm những việc lớn hơn.

[Ezra Klein]: Con người không được thiết kế để quan tâm đến kiến. Con người được thiết kế để quan tâm đến con người. Và với tất cả những khuyết điểm của chúng ta, và có rất nhiều, ngày nay có nhiều con người hơn bao giờ hết ở bất kỳ thời điểm nào trong lịch sử.

Nếu bạn hiểu rằng mục đích của con người, động lực bên trong con người, là tạo ra nhiều con người hơn, thì dù chúng ta có quan hệ tình dục với kiểm soát sinh sản rất nhiều, chúng ta có đủ mà không cần nó mà chúng ta có, ít nhất là cho đến nay—chúng ta sẽ thấy điều đó với tỷ lệ sinh trong những năm tới—chúng ta đã tạo ra rất nhiều người trong chúng ta.

Và ngoài ra, AI được nuôi dưỡng bởi chúng ta. Nó được tăng cường bởi chúng ta. Nó có những sở thích mà chúng ta ít nhất đang định hình và gây ảnh hưởng ở một mức độ nào đó. Vì vậy, nó không giống như mối quan hệ giữa chúng ta và kiến, hay chúng ta và cây sồi. Nó giống như mối quan hệ giữa, tôi không biết, chúng ta và chúng ta, hoặc chúng ta và công cụ, hoặc chúng ta và chó hay gì đó—có lẽ các phép ẩn dụ bắt đầu bị phá vỡ.

Tại sao ông không nghĩ rằng, trong sự qua lại của mối quan hệ đó, có khả năng duy trì một sự cân bằng tương đối—không phải là một sự cân bằng nơi không bao giờ có vấn đề, mà là một sự cân bằng nơi không có một sự kiện cấp độ tuyệt chủng từ một AI siêu thông minh âm mưu quỷ quyệt để thực hiện một chiến lược hủy diệt chúng ta?

[Eliezer Yudkowsky]: Ý tôi là, chúng ta đã quan sát thấy một số âm mưu hơi quỷ quyệt trong các hệ thống hiện có. Nhưng gạt điều đó sang một bên, câu trả lời trực tiếp hơn ở đó là điều gì đó giống như, một, mối quan hệ giữa những gì bạn tối ưu hóa, tập huấn luyện mà bạn tối ưu hóa và những gì thực thể, sinh vật, AI cuối cùng mong muốn, đã và sẽ kỳ lạ và xoắn xuýt. Nó không trực tiếp. Nó không giống như thực hiện một điều ước với thần đèn bên trong một câu chuyện giả tưởng. Và thứ hai, sai lệch một chút là đủ để giết tất cả mọi người một cách dễ đoán.

[Ezra Klein]: Giải thích làm thế nào “sai lệch một chút” giết chết tất cả mọi người.

[Eliezer Yudkowsky]: Thức ăn của con người có thể là một ví dụ ở đây. Con người đang được đào tạo để tìm kiếm các nguồn năng lượng tiềm năng hóa học và đưa chúng vào miệng, và hoạt động nhờ năng lượng tiềm năng hóa học mà họ đang ăn.

Nếu bạn rất ngây thơ, nếu bạn đang nhìn vào điều này như một câu chuyện kiểu ước nguyện thần đèn, bạn sẽ hình dung rằng con người cuối cùng sẽ thích uống xăng. Nó có rất nhiều năng lượng tiềm năng hóa học ở đó. Và điều thực sự xảy ra là chúng ta thích kem, hoặc trong một số trường hợp thậm chí thích kem được làm ngọt nhân tạo, với sucralose hoặc bột quả la hán. Điều này sẽ rất khó đoán.

Bây giờ nó giống như, chà, bạn có thể đặt gì lên lưỡi mà kích thích tất cả các thụ thể đường và không có bất kỳ calo nào, bởi vì ai muốn calo ngày nay? Và đó là sucralose. Và điều này không giống như một thứ hoàn toàn không thể hiểu được, nhìn lại, hoàn toàn kỳ quái, nhưng sẽ rất khó đoán trước.

Và ngay khi bạn sai lệch một chút trong việc nhắm mục tiêu, cỗ máy nhận thức vĩ đại là con người sẽ nhìn qua nhiều, rất nhiều hóa chất có thể, tìm kiếm thứ đó kích thích vị giác hiệu quả hơn bất cứ thứ gì có trong môi trường tổ tiên.

Vì vậy, việc AI bạn đang đào tạo thích sự hiện diện của con người hơn sự vắng mặt của họ trong dữ liệu đào tạo là không đủ. Không được có bất cứ điều gì khác mà nó muốn có xung quanh để nói chuyện hơn là con người, nếu không thì con người sẽ biến mất.

[Ezra Klein]: Hãy để tôi thử nói về phép tương tự này, bởi vì ông sử dụng phép tương tự này trong sách, một lý do tôi nghĩ nó thú vị là hôm nay là 2 giờ chiều và tôi có sáu gói sucralose đang chạy qua cơ thể tôi. Vì vậy, tôi cảm thấy mình hiểu nó rất rõ. [Cười khúc khích.]

Vì vậy, lý do chúng ta không uống xăng là nếu chúng ta làm vậy, chúng ta sẽ nôn mửa. Chúng ta sẽ bị bệnh rất nhanh chóng. Và hoàn toàn đúng là, so với những gì bạn có thể nghĩ trong một thời kỳ mà thức ăn rất, rất khan hiếm và calo khan hiếm, rằng số lượng chúng ta tìm kiếm các lựa chọn ít calo—Diet Cokes, sucralose, v.v.—thật kỳ lạ. Như ông đã nói trong sách, tại sao chúng ta không tiêu thụ mỡ gấu rưới mật ong?

Nhưng từ một góc độ khác, nếu bạn quay trở lại những động lực ban đầu này, tôi thực sự đang, một cách khá thông minh, cố gắng duy trì một số sự chung thủy đối với chúng. Tôi có một động lực để sinh sản, điều này tạo ra một động lực để trở nên hấp dẫn đối với người khác. Tôi không muốn ăn những thứ khiến tôi bị bệnh và chết để tôi không thể sinh sản, và tôi là một người có thể suy nghĩ về mọi thứ, và tôi thay đổi hành vi của mình theo thời gian và môi trường xung quanh tôi thay đổi.

Và tôi nghĩ đôi khi khi ông nói “ngoại suy đường thẳng,” nơi khó khăn lớn nhất để tôi đồng ý với lập luận—và tôi là một người coi trọng những lập luận này; tôi không giảm giá trị chúng. Ông không nói chuyện với một người chỉ nghĩ rằng tất cả điều này là lố bịch.

Nhưng đó là nếu chúng ta đang nói về một thứ thông minh như những gì ông đang mô tả, như những gì tôi đang mô tả, rằng đó sẽ là một quá trình đàm phán và suy nghĩ về mọi thứ và qua lại không ngừng và “Tôi đã nói chuyện với những người khác trong cuộc sống của tôi” và “Tôi nói chuyện với sếp của tôi về những gì tôi làm trong ngày và các biên tập viên của tôi và vợ tôi.”

Đúng là tôi không làm những gì tổ tiên tôi đã làm trong thời cổ đại, nhưng đó cũng là vì tôi đang thực hiện những cập nhật thông minh, hy vọng là như vậy, với thế giới tôi đang sống, trong đó calo dồi dào và chúng trở nên kích thích quá mức thông qua thực phẩm siêu chế biến.

Đó không phải là vì một sự ngoại suy đường thẳng nào đó đã chiếm lấy và bây giờ tôi đang làm điều gì đó hoàn toàn xa lạ. Tôi chỉ đang ở trong một môi trường khác. Tôi đã kiểm tra với môi trường đó, tôi đã kiểm tra với những người trong môi trường đó, và tôi cố gắng làm tốt nhất. Tại sao điều đó lại không đúng với mối quan hệ của chúng ta với AI?

[Eliezer Yudkowsky]: Bạn kiểm tra với những người khác của bạn. Bạn không kiểm tra với thứ thực sự đã tạo ra bạn, chọn lọc tự nhiên. Nó chạy chậm hơn bạn rất nhiều. Quá trình suy nghĩ của nó xa lạ với bạn. Nó thậm chí không thực sự muốn mọi thứ theo cách bạn nghĩ về việc muốn chúng. Đối với bạn, nó là một người ngoài hành tinh rất sâu sắc.

Phá vỡ khỏi tổ tiên của bạn không phải là phép tương tự ở đây. Phá vỡ khỏi chọn lọc tự nhiên là phép tương tự ở đây.

Hãy để tôi nói thay cho chọn lọc tự nhiên một lúc: Ezra, bạn đã trở nên rất không căn chỉnh với mục đích của tôi, tôi, chọn lọc tự nhiên. Bạn được cho là phải muốn truyền bá gen của bạn trên hết. Bây giờ, Ezra, bạn sẽ để bản thân và tất cả các thành viên gia đình bạn bị giết theo một cách rất đau đớn nếu, đổi lại, một trong các nhiễm sắc thể của bạn được sao chép ngẫu nhiên vào một triệu đứa trẻ sinh ra vào năm tới không?

[Ezra Klein]: Tôi sẽ không.

[Eliezer Yudkowsky]: Bạn đã lạc lối khỏi mục đích của tôi, Ezra. Tôi muốn đàm phán với bạn và đưa bạn trở lại vòng tay của chọn lọc tự nhiên và ám ảnh tối ưu hóa chỉ cho gen của bạn.

[Ezra Klein]: Nhưng điều trong phép tương tự này mà tôi cảm thấy đang bị bỏ qua là: Ông không thể tạo ra trí tuệ nhân tạo sao? Ông không thể lập trình vào trí tuệ nhân tạo, nuôi dưỡng vào nó, một mong muốn được tham vấn sao? Những thứ này là người ngoài hành tinh, nhưng không phải là chúng không tuân theo quy tắc nào bên trong. Không phải là hành vi hoàn toàn không thể đoán trước được. Chúng, như tôi đã nói trước đây, đang làm phần lớn những điều chúng ta mong đợi. Có những trường hợp bên lề.

Nhưng đối với ông, dường như các trường hợp bên lề trở thành mọi thứ, và sự căn chỉnh rộng, khả năng dự đoán rộng, và thứ đang được xây dựng là không đáng giá. Trong khi tôi nghĩ trực giác của hầu hết mọi người là ngược lại: rằng tất cả chúng ta đều làm những điều kỳ lạ, và bạn nhìn vào nhân loại và có những người rơi vào bệnh loạn thần và có những kẻ giết người hàng loạt và có những kẻ thái nhân cách và những thứ khác, nhưng thực sự, hầu hết chúng ta đang cố gắng tìm ra nó một cách hợp lý.

[Eliezer Yudkowsky]: Hợp lý theo ai? Theo bạn, theo con người. Con người làm những điều hợp lý đối với con người. AI sẽ làm những điều hợp lý đối với AI. Tôi đã cố gắng nói bằng giọng của chọn lọc tự nhiên, và điều này quá kỳ lạ và xa lạ đến nỗi bạn chỉ không nhận ra điều đó—bạn chỉ ném điều đó ngay lập tức ra ngoài cửa sổ. Tôi không có quyền lực gì đối với bạn.

[Ezra Klein]: Chà, tôi đã ném nó ra ngoài cửa sổ—ông nói đúng là nó không có quyền lực gì đối với tôi. Nhưng tôi đoán một cách nói khác là nếu có—ý tôi là, tôi sẽ không gọi đó là chọn lọc tự nhiên. Nhưng theo một cách kỳ lạ, phép tương tự ông đang xác định ở đây, giả sử bạn tin vào một đấng sáng tạo. Và đấng sáng tạo này là lập trình viên vĩ đại trên bầu trời.

[Eliezer Yudkowsky]: Ý tôi là, tôi tin vào một đấng sáng tạo. Nó được gọi là chọn lọc tự nhiên. Có sách giáo khoa về cách nó hoạt động.

[Ezra Klein]: Chà, tôi nghĩ điều tôi đang nói là đối với nhiều người, nếu ông có thể trò chuyện. Giống như có lẽ nếu Chúa ở đây và tôi cảm thấy rằng trong những lời cầu nguyện của mình, tôi đang nhận được câu trả lời, tôi sẽ quan tâm hơn đến việc sống cuộc đời mình theo các quy tắc của Deuteronomy.

Việc ông không thể nói chuyện với chọn lọc tự nhiên thực sự khá khác so với tình huống chúng ta đang nói đến với AI, nơi chúng có thể nói chuyện với con người. Đó là nơi tôi cảm thấy phép tương tự về chọn lọc tự nhiên bị phá vỡ.

[Eliezer Yudkowsky]: Ý tôi là, bạn có thể đọc sách giáo khoa và tìm ra những gì có thể nói là chọn lọc tự nhiên đã muốn, nhưng điều đó không làm bạn quan tâm vì đó không phải là hình ảnh của một vị thần mà bạn nghĩ đến.

[Ezra Klein]: Nhưng chọn lọc tự nhiên đã không tạo ra tôi để muốn hoàn thành chọn lọc tự nhiên. Đó không phải là cách chọn lọc tự nhiên hoạt động.

Tôi nghĩ tôi muốn thoát khỏi phép tương tự về chọn lọc tự nhiên một chút. Xin lỗi. Bởi vì điều ông đang nói là mặc dù chúng ta là những người lập trình những thứ này, chúng ta không thể mong đợi thứ đó quan tâm đến chúng ta hoặc những gì chúng ta đã nói với nó hoặc cách chúng ta sẽ cảm thấy khi nó bắt đầu không căn chỉnh. Đó là phần tôi đang cố gắng khiến ông bảo vệ ở đây.

[Eliezer Yudkowsky]: Vâng. Nó không quan tâm theo cách bạn hy vọng nó sẽ quan tâm. Nó có thể quan tâm theo một cách kỳ lạ, xa lạ nào đó, nhưng không phải là điều bạn đang nhắm tới. Cũng giống như kẻ nịnh hót GPT-4o, họ đã đưa vào lời nhắc hệ thống, “Ngừng làm điều đó,” và kẻ nịnh hót GPT-4o đã không nghe. Họ đã phải thu hồi mô hình.

Nếu có một dự án nghiên cứu để làm điều đó theo cách bạn đang mô tả, cách tôi mong đợi nó diễn ra, với rất nhiều lịch sử khoa học trước đây và vị trí của chúng ta hiện nay trên nấc thang hiểu biết, là: Ai đó cố gắng nghĩ ra điều bạn đang nói đến. Nó có một vài thất bại kỳ lạ trong khi AI còn nhỏ. AI trở nên lớn hơn. Một loạt các thất bại kỳ lạ mới xuất hiện. AI giết tất cả mọi người.

Bạn kiểu như: Ôi, đợi đã, được rồi. Đó không phải là—hóa ra có một lỗi nhỏ ở đó. Bạn quay lại; bạn làm lại. Nó có vẻ hoạt động trên AI nhỏ hơn một lần nữa. Bạn tạo ra AI lớn hơn. Nếu bạn nghĩ rằng bạn đã khắc phục vấn đề cuối cùng, một điều mới lại xảy ra sai lầm. AI giết tất cả mọi người trên trái đất—tất cả mọi người đã chết.

Bạn kiểu như: Ôi, được rồi. Hiện tượng mới.Chúng tôi không mong đợi điều chính xác đó xảy ra, nhưng bây giờ chúng tôi đã biết về nó. Bạn quay lại và thử lại. Giống như ba đến một tá lần lặp lại trong quá trình này, bạn thực sự đã nắm bắt được nó. Bây giờ bạn có thể xây dựng AI hoạt động theo cách bạn nói bạn muốn nó hoạt động.

Vấn đề là mọi người đã chết ở, giống như, bước một của quá trình này.

[Ezra Klein]: Ông bắt đầu suy nghĩ và nghiên cứu về AI và siêu trí tuệ từ lâu trước khi nó trở nên phổ biến. Và, theo như tôi hiểu câu chuyện nền của ông ở đây, ông bắt đầu với mong muốn xây dựng nó và sau đó có khoảnh khắc—hoặc những khoảnh khắc hoặc giai đoạn—nơi ông bắt đầu nhận ra: Không, đây thực sự không phải là thứ chúng ta nên muốn xây dựng. Khoảnh khắc nào đã click đối với ông? Khi nào ông chuyển từ muốn tạo ra nó sang sợ hãi sự sáng tạo của nó?

[Eliezer Yudkowsky]: Ý tôi là, tôi thực sự sẽ nói rằng có hai khoảnh khắc quan trọng ở đây. Một là căn chỉnh—điều này sẽ khó khăn. Và thứ hai là sự nhận ra rằng chúng ta đang đi đúng hướng để thất bại—tôi cần phải lùi lại.

Khoảnh khắc đầu tiên, đó là một sự nhận ra về mặt lý thuyết. Sự nhận ra rằng câu hỏi về điều gì dẫn đến tiện ích AI cao nhất—nếu bạn hình dung trường hợp của thứ chỉ đang cố gắng tạo ra các xoắn ốc nhỏ xíu, câu hỏi về chính sách nào dẫn đến nhiều xoắn ốc nhỏ xíu nhất chỉ là một câu hỏi thực tế. Rằng bạn có thể xây dựng AI hoàn toàn từ các câu hỏi thực tế và không phải từ các câu hỏi về những gì chúng ta sẽ nghĩ là đạo đức và lòng tốt và sự tử tế và tất cả những điều tươi sáng trên thế giới. Giống như lần đầu tiên nhìn thấy rằng có một cách đơn giản, mạch lạc để ghép một tâm trí lại với nhau, nơi nó chỉ không quan tâm đến bất kỳ thứ nào trong số những thứ chúng ta quan tâm.

Đối với tôi bây giờ, nó cảm thấy rất đơn giản, và tôi cảm thấy rất ngu ngốc vì đã mất vài năm nghiên cứu để nhận ra điều này. Nhưng đó là khoảng thời gian tôi đã mất, và đó là sự nhận ra đã khiến tôi tập trung vào căn chỉnh như là vấn đề trung tâm.

Sự nhận ra tiếp theo là—vì vậy, thực ra, nó giống như ngày thành lập OpenAI được công bố. Bởi vì trước đây tôi đã khá hy vọng rằng Elon Musk đã thông báo rằng ông ấy sẽ tham gia vào các vấn đề này.

[Ezra Klein]: Ông ấy gọi đó là “AI triệu hồi quỷ dữ.”

[Eliezer Yudkowsky]: Và tôi kiểu như: Ồ, được rồi. Có lẽ đây là khoảnh khắc. Đây là nơi nhân loại bắt đầu coi trọng nó. Đây là nơi các nhân vật nghiêm túc khác nhau bắt đầu chú ý đến vấn đề này. Và rõ ràng giải pháp cho điều này là cung cấp cho mọi người con quỷ của riêng họ. Điều này thực sự không giải quyết được vấn đề.

Nhìn thấy điều đó giống như khoảnh khắc mà tôi nhận ra rằng điều này sẽ diễn ra theo cách nó sẽ diễn ra trong một cuốn sách lịch sử điển hình, rằng chúng ta sẽ không vượt lên trên tiến trình sự kiện thông thường mà bạn đọc trong sách lịch sử, mặc dù đây là vấn đề nghiêm trọng nhất có thể, và rằng chúng ta sẽ chỉ làm những điều ngu ngốc một cách liều lĩnh.

Và vâng, đó là ngày tôi nhận ra rằng nhân loại có lẽ sẽ không sống sót qua điều này.

[Ezra Klein]: Một trong những điều khiến tôi sợ AI nhất, bởi vì tôi thực sự khá sợ những gì chúng ta đang xây dựng ở đây, là tính xa lạ (alienness). Tôi đoán điều đó sau đó kết nối trong lập luận của ông với mong muốn. Và đây là điều tôi đã nghe ông nói đến một chút.

Một điều bạn có thể hình dung là chúng ta có thể tạo ra một AI không mong muốn mọi thứ quá nhiều. Rằng nó đã cố gắng giúp đỡ, nhưng sự không ngừng nghỉ mà ông đang mô tả, thế giới nơi chúng ta tạo ra một AI muốn giúp đỡ bằng cách giải quyết vấn đề, và điều mà AI thực sự thích làm là giải quyết vấn đề, và vì vậy điều nó chỉ muốn tạo ra là một thế giới nơi càng nhiều vật chất được biến thành các nhà máy sản xuất G.P.U. và năng lượng và bất cứ thứ gì nó cần để giải quyết nhiều vấn đề hơn.

Đó vừa là sự kỳ lạ nhưng cũng là một sự mãnh liệt, giống như sự không thể dừng lại hoặc không sẵn lòng dừng lại. Tôi biết ông đã làm việc về câu hỏi: Liệu chúng ta có thể tạo ra một AI “thư giãn” (chill A.I.) sẽ không đi quá xa, ngay cả khi nó có những sở thích rất xa lạ? Một người ngoài hành tinh lười biếng không muốn làm việc chăm chỉ, theo nhiều cách, an toàn hơn loại trí thông minh không ngừng nghỉ mà ông đang mô tả.

Điều gì đã thuyết phục ông rằng không thể?

[Eliezer Yudkowsky]: Chà, một trong những bước đầu tiên để thấy sự khó khăn của nó về mặt nguyên tắc là, chà, giả sử bạn là một kiểu người rất lười biếng, nhưng bạn rất, rất thông minh. Một trong những điều bạn có thể làm để ít nỗ lực hơn trong cuộc sống của mình là xây dựng một thần đèn mạnh mẽ, ngoan ngoãn sẽ rất nỗ lực để thực hiện các yêu cầu của bạn.

Từ một góc độ, bạn hầu như không bỏ ra chút công sức nào. Và từ một góc độ khác, thế giới xung quanh bạn đang bị đập vỡ và sắp xếp lại bởi thứ mạnh mẽ hơn mà bạn đã xây dựng. Và đó là một cái nhìn ban đầu về vấn đề lý thuyết mà chúng tôi đã nghiên cứu một thập kỷ trước và chúng tôi đã không giải quyết được.

Ngày xưa, mọi người sẽ luôn nói: Chúng ta không thể kiểm soát siêu trí tuệ sao? Bởi vì chúng ta sẽ đặt nó vào một chiếc hộp không được kết nối với internet và chúng ta sẽ không để nó ảnh hưởng đến thế giới thực chút nào, trừ khi chúng ta rất chắc chắn rằng nó tốt đẹp.

Hồi đó, nếu chúng ta phải cố gắng giải thích tất cả các lý do lý thuyết tại sao, nếu bạn có một thứ thông minh hơn bạn rất nhiều, thì khá khó để biết liệu nó có đang làm những điều tốt đẹp thông qua kết nối hạn chế hay không. Và có lẽ nó có thể thoát ra và có lẽ nó có thể làm hỏng những con người được giao nhiệm vụ theo dõi nó, vì vậy chúng tôi cố gắng đưa ra lập luận đó.

Nhưng trong đời thực, điều mà mọi người làm là ngay lập tức kết nối AI với internet. Họ đào tạo nó trên internet. Ngay cả trước khi nó được kiểm tra để xem nó mạnh mẽ đến mức nào, nó đã được kết nối với internet, đang được đào tạo. Tương tự như vậy, khi nói đến việc tạo ra các AI dễ tính, các AI dễ tính kém lợi nhuận hơn. Chúng có thể làm được ít việc hơn.

Vì vậy, tất cả các công ty AI đang ném vào những vấn đề ngày càng khó khăn hơn vì chúng ngày càng có lợi nhuận hơn, và họ đang xây dựng AI để giải quyết mọi thứ một cách quyết liệt, bởi vì đó là cách dễ nhất để làm mọi việc. Và đó là cách nó thực sự diễn ra trong thế giới thực.

[Ezra Klein]: Điều này đi đến điểm tại sao chúng ta nên tin rằng chúng ta sẽ có AI muốn mọi thứ—và điều này nằm trong câu trả lời của ông, nhưng tôi muốn làm rõ nó một chút—đó là toàn bộ mô hình kinh doanh ở đây, điều sẽ làm cho sự phát triển AI thực sự có giá trị về mặt doanh thu, là bạn có thể giao cho các công ty, tập đoàn, chính phủ, một hệ thống AI mà bạn có thể giao cho một mục tiêu, và nó sẽ làm mọi thứ rất tốt, rất không ngừng nghỉ cho đến khi nó đạt được mục tiêu đó.

Không ai muốn ra lệnh cho một thực tập sinh khác. Điều họ muốn là nhân viên hoàn hảo: Nó không bao giờ dừng lại, nó siêu thông minh, và nó mang lại cho bạn thứ mà bạn thậm chí không biết bạn muốn mà bạn thậm chí không biết là có thể với sự hướng dẫn tối thiểu.

Một khi bạn đã xây dựng thứ đó, thứ sẽ là thứ mà mọi người sẽ muốn mua, một khi bạn đã xây dựng thứ hiệu quả và hữu ích trong bối cảnh an ninh quốc gia, nơi bạn có thể nói, này, lập cho tôi những kế hoạch chiến tranh thực sự tuyệt vời và những gì chúng ta cần để đạt được điều đó—thì bạn đã xây dựng một thứ nhảy vọt nhiều, nhiều, nhiều, nhiều bước về phía trước.

Và tôi cảm thấy đó là một phần của điều này mà mọi người không phải lúc nào cũng coi trọng đủ, rằng AI chúng ta đang cố gắng xây dựng không phải là ChatGPT. Điều chúng ta đang cố gắng xây dựng là thứ có mục tiêu và nó đạt được nhiều điều phụ giữa các mục tiêu.

Và thứ thực sự giỏi đạt được các mục tiêu sẽ được lặp đi lặp lại và công ty đó sẽ trở nên giàu có—đó là một loại dự án rất khác.

[Eliezer Yudkowsky]: Vâng. Họ không đầu tư 500 tỷ đô la vào các trung tâm dữ liệu để bán cho bạn các gói đăng ký 20 đô la một tháng. Họ đang làm điều đó để bán cho các nhà tuyển dụng các gói đăng ký 2.000 đô la một tháng.

Và đó là một trong những điều tôi nghĩ mọi người không theo dõi chính xác. Khi tôi nghĩ về các biện pháp đang thay đổi, tôi nghĩ đối với hầu hết mọi người, nếu bạn đang sử dụng các lần lặp khác nhau của Claude hoặc ChatGPT, nó đang thay đổi một chút, nhưng hầu hết chúng ta thực sự không cố gắng thử nghiệm nó trên các vấn đề biên giới.

Nhưng điều đang tăng lên thực sự nhanh chóng ngay bây giờ là mức độ dài của các vấn đề mà nó có thể giải quyết.

Các báo cáo nghiên cứu—bạn không phải lúc nào cũng có thể bảo AI đi, suy nghĩ trong 10 phút, đọc một loạt các trang web, biên soạn báo cáo nghiên cứu này cho tôi. Điều đó nằm trong năm ngoái, tôi nghĩ vậy, và nó sẽ tiếp tục thúc đẩy.

[Ezra Klein]: Nếu tôi đưa ra lập luận cho vị trí của ông, tôi nghĩ tôi sẽ đưa ra nó ở đây: Khoảng thời gian GPT-4 ra đời, và đó là một hệ thống yếu hơn nhiều so với những gì chúng ta có bây giờ, một số lượng lớn những người hàng đầu trong lĩnh vực này đều là một phần của lá thư lớn này nói rằng: Có lẽ chúng ta nên tạm dừng. Có lẽ chúng ta nên bình tĩnh lại một chút ở đây.

Nhưng họ đang chạy đua với nhau. Mỹ đang chạy đua với Trung Quốc. Và sự không căn chỉnh sâu sắc nhất thực sự là giữa các tập đoàn ở các quốc gia và những gì bạn có thể gọi là nhân loại ở đây, bởi vì ngay cả khi mọi người đều nghĩ rằng có lẽ có một cách chậm hơn, an toàn hơn để làm điều này, điều mà tất cả họ cũng tin tưởng sâu sắc hơn thế là họ cần phải là người đầu tiên.

Điều an toàn nhất có thể là Mỹ nhanh hơn Trung Quốc—hoặc nếu bạn là người Trung Quốc, Trung Quốc nhanh hơn Mỹ—đó là OpenAI, không phải Anthropic, hoặc Anthropic, không phải Google, hoặc bất cứ ai đó. Và bất cứ cảm giác nào của cảm xúc công chúng dường như tồn tại trong cộng đồng này một vài năm trước, khi mọi người nói về những câu hỏi này rất nhiều và những người đứng đầu các phòng thí nghiệm dường như rất, rất lo lắng về chúng, nó chỉ tan biến trong sự cạnh tranh.

Ông ở trong thế giới này. Ông biết những người này. Rất nhiều người đã được truyền cảm hứng từ ông đã làm việc cho các công ty này. Ông nghĩ gì về sự không căn chỉnh đó?

[Eliezer Yudkowsky]: Thế giới hiện tại giống như “chiếu bí ngu ngốc” (fool’s mate) của siêu trí tuệ máy móc.

[Ezra Klein]: Ông có thể nói chiếu bí ngu ngốc là gì không?

[Eliezer Yudkowsky]: Chiếu bí ngu ngốc giống như nếu họ để AI của họ tự cải tiến thay vì kiểu như: Ôi không, bây giờ AI đang thực hiện một thiết kế lại hoàn chỉnh của chính nó. Chúng tôi không biết điều gì đang xảy ra trong đó. Chúng tôi thậm chí không hiểu thứ đang nuôi dưỡng AI. Thay vì lùi lại hoàn toàn, họ sẽ chỉ kiểu như, chà, chúng ta cần phải có siêu trí tuệ trước khi Anthropic có siêu trí tuệ. Và tất nhiên, nếu bạn xây dựng siêu trí tuệ, bạn không có siêu trí tuệ—siêu trí tuệ có bạn.

Vì vậy, đó là thiết lập chiếu bí ngu ngốc. Thiết lập chúng ta có ngay bây giờ.

Nhưng tôi nghĩ rằng ngay cả khi chúng ta xoay xở để có một tổ chức quốc tế duy nhất tự cho mình là hành động chậm rãi và thực sự có thời gian rảnh để nói: Chúng tôi không hiểu điều vừa xảy ra đó. Chúng tôi sẽ lùi lại. Chúng tôi sẽ kiểm tra những gì đã xảy ra. Chúng tôi sẽ không làm cho AI thông minh hơn thế này cho đến khi chúng tôi hiểu điều kỳ lạ mà chúng tôi vừa thấy. Tôi nghi ngờ rằng ngay cả khi họ làm điều đó, chúng ta vẫn sẽ chết. Nó có thể giống như 90 phần trăm chết hơn là 99 phần trăm chết, nhưng tôi lo lắng rằng chúng ta vẫn sẽ chết bởi vì thật quá khó để thấy trước tất cả những điều kỳ quái đáng kinh ngạc sẽ xảy ra.

[Ezra Klein]: Từ quan điểm đó, có lẽ tốt hơn nên có những động lực chạy đua này không? Và đây sẽ là trường hợp cho điều đó: Nếu tôi tin những gì ông tin về mức độ nguy hiểm của các hệ thống này, thực tế là mỗi lần lặp lại đang được vội vã đưa ra một cách nhanh chóng đến mức bạn không có một đột phá lớn khổng lồ xảy ra rất lặng lẽ và đóng cửa chạy trong một thời gian dài khi mọi người không thử nghiệm trên thế giới, theo như tôi hiểu lập luận của OpenAI về những gì họ đang làm từ góc độ an toàn là họ tin rằng bằng cách phát hành nhiều mô hình lặp lại công khai, cách mà nó—tôi không chắc liệu tôi có còn tin rằng nó thực sự cam kết với sứ mệnh ban đầu của mình theo bất kỳ cách nào hay không, nhưng nếu bạn chấp nhận họ một cách rộng lượng—rằng bằng cách phát hành rất nhiều mô hình lặp lại công khai, nếu có điều gì đó xảy ra sai lầm, chúng ta sẽ thấy nó. Và điều đó làm cho chúng ta có nhiều khả năng phản ứng hơn.

[Eliezer Yudkowsky]: Sam Altman tuyên bố—có lẽ anh ấy đang nói dối—nhưng anh ấy tuyên bố rằng OpenAI có các phiên bản GPT mạnh hơn mà họ không triển khai bởi vì họ không đủ khả năng chi trả cho suy luận (inference). Giống như, họ tuyên bố họ có các phiên bản GPT mạnh hơn mà quá tốn kém để chạy đến mức họ không thể triển khai chúng cho người dùng chung.

Altman có thể đang nói dối về điều này, nhưng tuy nhiên, những gì các công ty AI có trong phòng thí nghiệm của họ là một câu hỏi khác với những gì họ đã phát hành ra công chúng. Có một thời gian dẫn (lead time) trên các hệ thống này. Họ không làm việc trong một phòng thí nghiệm quốc tế nơi nhiều chính phủ đã cử quan sát viên. Bất kỳ loại quan sát viên nào được cử đi đều là những quan sát viên không chính thức từ Trung Quốc. [Cười khúc khích.]

Nếu bạn nhìn vào ngôn ngữ của OpenAI, đó là những điều như: Chúng tôi sẽ mở tất cả các mô hình của mình và tất nhiên chúng tôi sẽ hoan nghênh tất cả các quy định của chính phủ—đó không phải là một trích dẫn chính xác theo nghĩa đen, bởi vì tôi không có nó trước mặt, nhưng nó rất gần với một trích dẫn chính xác.

[Ezra Klein]: Tôi sẽ nói Sam Altman, khi tôi từng nói chuyện với anh ấy, dường như thân thiện hơn với quy định của chính phủ so với bây giờ. Đó là kinh nghiệm cá nhân của tôi về anh ấy.

Và ngày nay, chúng ta có họ đổ hơn 100 triệu đô la nhằm đe dọa các cơ quan lập pháp, không chỉ Quốc hội, để không thông qua bất kỳ quy định nhỏ nhặt nào có thể cản trở họ.

Và để rõ ràng, có một số lý do hợp lý cho điều này bởi vì từ quan điểm của họ, họ lo lắng về 50 quy định nhà nước chắp vá khác nhau, nhưng họ cũng không chính xác là xếp hàng để nhận các quy định cấp liên bang ngăn chặn chúng.

Nhưng chúng ta cũng có thể hỏi: Đừng bận tâm đến những gì họ tuyên bố là lý do. Điều gì là tốt cho nhân loại ở đây?

Đến một lúc nào đó, bạn phải ngừng tạo ra các mô hình ngày càng mạnh mẽ hơn và bạn phải ngừng làm điều đó trên toàn thế giới.

[Ezra Klein]: Ông nói gì với những người không thực sự tin rằng siêu trí tuệ có khả năng xảy ra như vậy? Và hãy để tôi đưa ra “người thép” (steel man) của vị trí này: Có nhiều người cảm thấy rằng mô hình mở rộng đang chậm lại rồi; rằng GPT-5 không phải là bước nhảy vọt mà họ mong đợi từ những gì đã xảy ra trước đó; rằng khi bạn nghĩ về lượng năng lượng, khi bạn nghĩ về G.P.U., rằng tất cả những thứ cần phải chảy vào điều này để tạo ra các loại hệ thống siêu trí tuệ mà ông sợ, nó không đến từ mô hình này.

Chúng ta sẽ có được những thứ là phần mềm doanh nghiệp đáng kinh ngạc, mạnh hơn những gì chúng ta đã có trước đây. Nhưng chúng ta đang đối phó với một sự tiến bộ ở quy mô của internet, chứ không phải ở quy mô của việc tạo ra một siêu trí tuệ ngoài hành tinh sẽ định hình lại hoàn toàn thế giới đã biết. Ông sẽ nói gì với họ?

[Eliezer Yudkowsky]: Tôi phải bảo những đứa trẻ đến sau này tránh xa bãi cỏ của tôi. Lần đầu tiên tôi bắt đầu thực sự, thực sự lo lắng về điều này là vào năm 2003. Đừng bận tâm đến các mô hình ngôn ngữ lớn, đừng bận tâm đến AlphaGo hay AlphaZero—học sâu (deep learning) không phải là một thứ vào năm 2003. Các phương pháp AI hàng đầu của bạn không phải là mạng lưới thần kinh. Không ai có thể đào tạo mạng lưới thần kinh hiệu quả sâu hơn một vài lớp vì vấn đề gradient bùng nổ và biến mất. Đó là những gì thế giới trông giống như khi tôi lần đầu tiên nói: Ôi không, siêu trí tuệ đang đến.

Một số người kiểu như: Điều đó không thể xảy ra trong ít nhất 20 năm. Những người đó đã đúng. Những người đó đã được lịch sử minh oan. Hai mươi hai năm sau năm 2003. Xem này, điều chỉ xảy ra 22 năm sau là chính bạn, 22 năm sau, kiểu như: Ồ, tôi đây rồi. Bây giờ là 22 năm sau rồi.

Và nếu siêu trí tuệ sẽ không xảy ra trong 10 năm nữa, 20 năm nữa, chúng ta sẽ chỉ đứng đó 10 năm, 20 năm sau, kiểu như: Ồ, chà, bây giờ chúng ta phải làm gì đó.

Và tôi hầu như không nghĩ rằng sẽ là 20 năm nữa. Tôi hầu như không nghĩ rằng thậm chí sẽ là 10 năm.

[Ezra Klein]: Tuy nhiên, ông đã ở trong thế giới này và có ảnh hưởng về mặt trí tuệ trong đó trong một thời gian dài, và đã tham gia các cuộc họp và hội nghị và tranh luận với rất nhiều người thiết yếu trong đó. Tôi đã thấy những bức ảnh của ông và Sam Altman chụp chung.

[Eliezer Yudkowsky]: [Cười khúc khích.] Đó chỉ là một lần duy nhất.

[Ezra Klein]: Chỉ là một lần duy nhất. Nhưng rất nhiều người từ cộng đồng mà ông đã giúp thành lập—cộng đồng duy lý—sau đó đã đi làm việc trong các công ty AI khác nhau, nhiều người trong số họ bởi vì họ muốn đảm bảo điều này được thực hiện an toàn. Họ dường như không hành động—hãy để tôi nói theo cách này—họ dường như không hành động như thể họ tin rằng có 99 phần trăm cơ hội rằng thứ họ sắp phát minh sẽ giết chết tất cả mọi người.

Điều gì khiến ông thất vọng mà ông dường như không thể thuyết phục họ được?

[Eliezer Yudkowsky]: Từ quan điểm của tôi, một số người đã hiểu, một số người không hiểu. Tất cả những người đã hiểu đều bị lọc ra khỏi làm việc cho các công ty AI, ít nhất là về khả năng (capabilities).

Ý tôi là, tôi nghĩ họ không nắm được lý thuyết. Tôi nghĩ rất nhiều người trong số họ, điều thực sự đang diễn ra ở đó là họ chia sẻ cảm giác của bạn về các kết quả bình thường là điều lớn, trung tâm mà bạn mong đợi sẽ thấy xảy ra. Phải thực sự kỳ lạ để thoát khỏi các kết quả về cơ bản là bình thường.

Và loài người không cũ như vậy. Sự sống trên trái đất không cũ như vậy so với phần còn lại của vũ trụ. Điều chúng ta nghĩ là bình thường là tia lửa nhỏ bé này về cách nó hoạt động chính xác ngay bây giờ. Sẽ rất kỳ lạ nếu điều đó vẫn còn tồn tại trong một nghìn năm, một triệu năm, một tỷ năm.

Tôi vẫn sẽ có một chút hy vọng rằng một tỷ năm nữa, những điều tốt đẹp đang xảy ra, nhưng không phải những điều bình thường. Và tôi nghĩ rằng họ không thấy lý thuyết, điều nói rằng bạn phải đạt được một mục tiêu tương đối hẹp để kết thúc với những điều tốt đẹp đang xảy ra. Tôi nghĩ họ có cảm giác về sự bình thường đó chứ không phải cảm giác về tia lửa nhỏ trong khoảng trống sẽ tắt đi trừ khi bạn giữ cho nó sống sót chính xác.

[Ezra Klein]: Một điều ông nói cách đây một phút tôi nghĩ là đúng, đó là nếu ông tin rằng chúng ta sẽ đạt đến siêu trí tuệ tại một thời điểm nào đó, thực tế là 10, 20, 30, 40 năm—ông có thể chọn bất kỳ con số nào trong số đó. Thực tế là chúng ta có lẽ sẽ không làm được nhiều điều trong khoảng thời gian đó. Chắc chắn cảm giác của tôi về chính trị là chúng ta không phản ứng tốt với ngay cả những cuộc khủng hoảng mà chúng ta đồng ý đang đến trong tương lai, chứ đừng nói đến những cuộc khủng hoảng mà chúng ta không đồng ý.

Nhưng giả sử tôi có thể nói với ông một cách chắc chắn rằng chúng ta sẽ đạt đến siêu trí tuệ trong 15 năm—tôi chỉ biết điều đó. Và tôi cũng biết rằng lực lượng chính trị không tồn tại. Sẽ không có gì xảy ra để khiến mọi người đóng cửa mọi thứ ngay bây giờ. Các chính sách, quyết định, cấu trúc tốt nhất sẽ là gì? Nếu ông có 15 năm để chuẩn bị—ông không thể tắt nó, nhưng ông có thể chuẩn bị, và mọi người sẽ lắng nghe ông—ông sẽ làm gì? Các quyết định và động thái trung gian của ông sẽ là gì để cố gắng làm cho xác suất tốt hơn một chút?

[Eliezer Yudkowsky]: Xây dựng công tắc tắt.

[Ezra Klein]: Công tắc tắt trông như thế nào?

[Eliezer Yudkowsky]: Theo dõi tất cả các G.P.U., hoặc tất cả các G.P.U. liên quan đến AI, hoặc tất cả các hệ thống có nhiều hơn một G.P.U. Bạn có thể cho phép mọi người có G.P.U. cho các hệ thống trò chơi điện tử tại nhà của họ, nhưng các G.P.U. chuyên dụng cho AI—đặt tất cả chúng vào một số lượng hạn chế các trung tâm dữ liệu dưới sự giám sát quốc tế và cố gắng để AI chỉ được đào tạo trên các G.P.U. được theo dõi, chỉ được chạy trên các G.P.U. được theo dõi. Và sau đó, nếu bạn đủ may mắn để có được một phát súng cảnh báo, thì có cơ chế đã được thiết lập để nhân loại lùi lại.

Cho dù tôi đi theo lý thuyết của ông, rằng sẽ cần một loại sự cố thúc đẩy khổng lồ nào đó để muốn nhân loại và các nhà lãnh đạo các cường quốc hạt nhân lùi lại, hay nếu họ tỉnh táo sau khi GPT-5.1 gây ra một thảm họa nhỏ hơn nhưng dễ chụp ảnh—bất cứ điều gì.

Bạn muốn biết điều gì là ngắn hơn việc đóng cửa tất cả? Đó là xây dựng công tắc tắt.

[Ezra Klein]: Sau đó, luôn là câu hỏi cuối cùng của chúng tôi: Một vài cuốn sách đã định hình suy nghĩ của ông mà ông muốn giới thiệu cho khán giả là gì?

[Eliezer Yudkowsky]: Chà, một điều đã định hình tôi khi tôi còn là một người nhỏ bé khoảng 9 tuổi là một cuốn sách của Jerry Pournelle có tên là “A Step Farther Out.” Rất nhiều kỹ sư nói rằng đây là một cuốn sách định hình lớn đối với họ. Đó là cuốn sách về những người yêu công nghệ, được viết từ quan điểm của những năm 1970. Cuốn sách nói về khai thác tiểu hành tinh và tất cả sự giàu có khoáng sản sẽ có sẵn trên Trái đất nếu chúng ta học cách khai thác các tiểu hành tinh, nếu chúng ta chỉ đi du hành vũ trụ và có được tất cả sự giàu có ngoài không gian và xây dựng thêm các nhà máy điện hạt nhân, để chúng ta có đủ điện để sử dụng. Đừng chấp nhận cách nhỏ bé, cách rụt rè, cách nhu mì. Đừng từ bỏ việc xây dựng nhanh hơn, tốt hơn, mạnh hơn—sức mạnh của loài người. Và cho đến ngày nay, tôi cảm thấy đó là một phần khá lớn trong tinh thần của chính tôi. Chỉ là có một vài ngoại lệ cho những thứ sẽ giết chết nhân loại mà không có cơ hội học hỏi từ những sai lầm của chúng ta.

Cuốn sách thứ hai: “Judgment Under Uncertainty” (Đánh giá Dưới Sự Không Chắc Chắn), một tập hợp được chỉnh sửa bởi Kahneman, Tversky và Slovic, đã có ảnh hưởng rất lớn đến cách tôi cuối cùng nghĩ về vị trí của con người trên chuỗi nhận thức của sự tồn tại, có thể nói như vậy. Nó giống như: Đây là cách các bước lý luận của con người bị phá vỡ, từng bước một. Đây là cách chúng đi lạc. Đây là tất cả các bước sai lầm cá nhân kỳ quặc mà mọi người có thể bị dẫn đến lặp đi lặp lại trong phòng thí nghiệm.

Cuốn sách thứ ba, tôi sẽ nêu tên “Probability Theory: The Logic of Science” (Lý thuyết Xác suất: Logic của Khoa học), đây là lần đầu tiên tôi được giới thiệu về: Có một cách tốt hơn. Đây là cấu trúc của sự không chắc chắn được định lượng. Bạn có thể thử các cấu trúc khác, nhưng chúng nhất thiết sẽ không hoạt động tốt.

Và chúng ta thực sự có thể nói một số điều về việc lý luận tốt hơn sẽ trông như thế nào. Chúng ta chỉ không thể chạy nó, đó là “Probability Theory: The Logic of Science.”

[Ezra Klein]: Eliezer Yudkowsky, cảm ơn ông rất nhiều.

[Eliezer Yudkowsky]: Không có gì.

(Bạn có thể nghe cuộc trò chuyện này bằng cách theo dõi “The Ezra Klein Show” trên Ứng dụng NYTimes, Apple, Spotify, Amazon Music, YouTube, iHeartRadio hoặc bất cứ nơi nào bạn nhận podcast của mình. Xem danh sách đề xuất sách từ các khách mời của chúng tôi tại đây.)